💡 Key Takeaways auf einen Blick

- LLMs revolutionieren die Mensch-Maschine-Interaktion durch Textverarbeitung.

- Die Transformer-Architektur ermöglicht kontextuelle Informationsverarbeitung.

- Ethische Herausforderungen und Ressourcennutzung sind relevante Themen.

Large Language Models (LLMs) sind eine revolutionäre Entwicklung im Bereich der künstlichen Intelligenz, die durch ihre Fähigkeit, natürliche Sprache zu verstehen und zu generieren, erhebliche Fortschritte in der Automatisierung und der Mensch-Maschine-Interaktion ermöglicht haben. Diese Modelle basieren auf komplexen neuronalen Netzen und sind darauf trainiert, Muster in riesigen Mengen an Textdaten zu erkennen. In den folgenden Abschnitten werden wir die Definition und das grundlegende Funktionsprinzip von LLMs, ihre zugrunde liegende Architektur sowie die hauptverantwortlichen Algorithmen für ihr Training untersuchen.

Definition und Funktionsprinzip

Large Language Models sind im Wesentlichen tief lernende Modelle, die darauf ausgelegt sind, menschenähnliche Texte zu generieren oder zu verstehen. Die grundlegende Idee hinter diesen Modellen ist es, Texte als Sequenzen von Tokens zu betrachten, wobei ein Token typischerweise ein Wort oder ein Teil eines Wortes ist. Um die Bedeutung und den Kontext von Sprache zu erfassen, nutzen LLMs Techniken des Natural Language Processing (NLP) in Kombination mit statistischen Analysemethoden.

Der Prozess des Lernens für LLMs erfolgt in mehreren Schritten. Zunächst werden sie mit einem großen Korpus an Texten trainiert, der aus Büchern, Artikeln, Webseiten und anderen schriftlichen Quellen besteht. Während des Trainings lernt das Modell, wie Wörter und Sätze zusammenhängen und wie sie die Absicht oder den Kontext einer Nachricht vermitteln. Es verwendet Transformer-Architektur, um die Beziehungen zwischen den Tokens im Text zu bestimmen, was es dem Modell ermöglicht, kontextuelle Informationen zu berücksichtigen und präzisere Vorhersagen zu treffen.

Ein zentrales Konzept bei LLMs ist das so genannte “self-supervised learning”. Hierbei wird das Modell ohne explizite Annotationsdaten trainiert, indem es versucht, Texte zu vervollständigen oder vorherzusagen. Diese Technik hat den Vorteil, dass sie das Modell durch verschiedene Datenmuster und -variationen in einem umfangreichen Textkorpus robust macht, was wiederum die Übertragung von Wissen auf neue, unbekannte Daten verbessert.

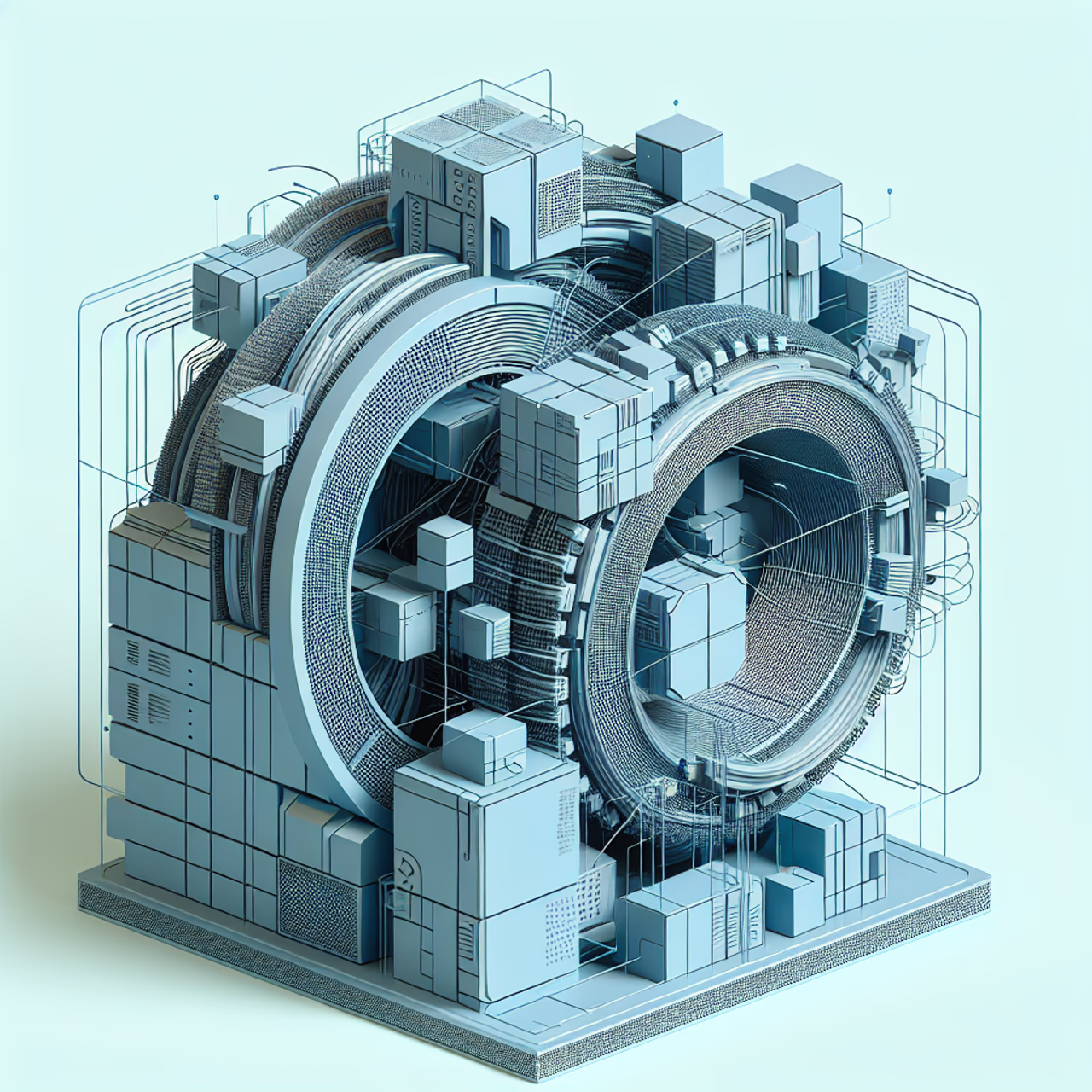

Architektur von Large Language Models

Die Architektur von LLMs basiert auf der Transformer-Architektur, die 2017 von Vaswani et al. entwickelt wurde. Diese Architektur hat die Handhabung von zeitlichen Abhängigkeiten in Texten durch den Einsatz von Selbst-Attention revolutioniert. Anstelle von rekursiven oder sequenziellen Verarbeitungsmethoden verwendet der Transformer Mechanismen, die es dem Modell ermöglichen, beim Verarbeiten eines Tokens auf alle vorherigen Tokens zuzugreifen. Dies erleichtert es dem Modell, den Kontext zu verstehen und relevante Informationen effektiv zu integrieren.

Farbbereiche und Schichten

Ein typisches LLM besteht aus mehreren Schichten, wobei jede Schicht sowohl eine Selbst-Attention- als auch eine Feedforward-Netzwerk-Komponente enthält. Bei den Selbst-Attention-Schichten wird beurteilt, wie viel Aufmerksamkeit jede Position im Text auf eine andere Position legen sollte. Dies unterstützt das Modell dabei, Bedeutung zu extrahieren und zu erkennen, in welchen Kontexten bestimmte Worte vorkommen.

Die Feedforward-Netzwerke hingegen übernehmen die Aufgabe, die in den Selbst-Attention-Schichten gewonnenen Informationen in hochdimensionale Darstellungen umzuwandeln. Diese Schichten sind durch Aktivierungsfunktionen wie die Gelu (Gaussian Error Linear Unit) miteinander verbunden, die die von den neuronalen Netzwerken gelieferten Ausgaben nicht-linear transformieren.

Embedding und Positionale Codierung

Ein weiteres Schlüsselelement in der Architektur von LLMs ist das Konzept der Embeddings und der Positional Encoding. Token werden zunächst in hochdimensionale Vektoren, so genannte Embeddings, umgewandelt, die eine dichte Repräsentation des semantischen Inhalts jedes Tokens bieten. Positional Encoding wird verwendet, um den Tokens Informationen über ihre relative Position im Text zu geben, da der Transformer keine inhärente Reihenfolge in den Eingabedaten vorfindet.

Ein vollständig trainiertes LLM kann verschiedene NLP-Aufgaben wie maschinelles Übersetzen, Textzusammenfassungen oder sogar das Beantworten von Fragen mit hoher Genauigkeit durchführen – Fähigkeiten, die durch die Komplexität ihres neuronalen Netzwerks und die Menge der trainierten Daten ermöglicht werden.

Schlüsselalgorithmen für das Training

Das Training von LLMs erfordert den Einsatz einer Vielzahl fortschrittlicher Algorithmen und Techniken, die darauf abzielen, die Effizienz und Effektivität der Lernprozesse zu maximieren. Ein zentraler Algorithmus, der in diesem Kontext oft verwendet wird, ist der sogenannte Adam-Optimierer. Adam ist ein Gradient-Descent-Algorithmus, der adaptive Lernraten verwendet und für große Datensätze und Parameteroptimierungen geeignet ist. Er kombiniert die Vorteile der AdaGrad- und RMSProp-Algorithmen, indem er sowohl die ersten als auch die zweiten Momente des Gradienten speichert.

Batch Normalization und Layer Normalization

Um die Stabilität des Lernprozesses zu erhöhen, wird oft die Technik der Layer Normalization eingesetzt. Diese Normalisierung erfolgt auf Ebene der Schichten eines neuronalen Netzwerks und hilft dabei, die Verteilungen der Inputs für jede Schicht konstant zu halten, was in der Regel zu schnelleren Lernraten und weniger instabilen Trainingsverläufen führt.

Transfer-LeARNING

Ein weiteres wichtiges Konzept im Training von LLMs ist das Transfer-Learning. Dabei wird ein vortrainiertes Modell auf spezifische, oft kleinere Datensätze angepasst, um die Leistung für spezifische Aufgaben zu verbessern. Diese Methode ist besonders effizient, da sie es ermöglicht, aus vorherigem Wissen zu schöpfen und die Trainingszeit drastisch zu reduzieren.

Die Kombination dieser Algorithmen und Techniken, einschließlich stochastic gradient descent und anderen, bildet die Grundlage für das Training von LLMs und trägt entscheidend zu ihrer beeindruckenden Leistungsfähigkeit bei.

Herausforderungen und Grenzen von LLMs

Trotz der Fortschritte und hochgradigen Fähigkeiten von LLMs gibt es signifikante Herausforderungen und Grenzen, die die praktische Anwendbarkeit dieser Technologien betreffen. Eine der größten Sorgen ist die Frage der ethischen Bedenken und des Bias in den generierten Inhalten. Da die Modelle auf riesigen Mengen an Textdaten trainiert werden, die potenziell voreingenommene oder diskriminierende Ansichten widerspiegeln, besteht die Gefahr, dass diese Vorurteile unbewusst reproduziert werden. Dieses Phänomen kann nicht nur zu ungerechten Ergebnissen führen, sondern auch die Nutzungserfahrung für diverse Benutzergruppen negativ beeinflussen. Explainable Artificial Intelligence (XAI) ist in diesem Kontext besonders relevant, da sie einen besseren Einblick in die Entscheidungsprozesse der Modelle bietet und dabei hilft, die Automatismen zu entschlüsseln.

Zusätzlich leidet die Performance von LLMs unter dem Problem der Überanpassung (Overfitting). Dies geschieht, wenn ein Modell zu stark auf den Trainingsdaten gefüttert wird und nicht mehr in der Lage ist, auf neue, ungesehene Daten zu generalisieren. Diese Herausforderung erfordert sorgfältige Überwachung und Optimierung des Trainingsprozesses, um ein gesundes Gleichgewicht zwischen Lernen und Generalisierung zu finden.

Ein weiteres ernstzunehmendes Thema ist die Rechenintensität von LLMs. Die neuronalen Netze, aus denen sie bestehen, erfordern enorme Rechenressourcen, was zu hohen Energieverbrauch und CO2-Emissionen führt. Um diese Herausforderungen zu adressieren, ist es notwendig, neue Techniken der Ökologisierung der KI zu erforschen. Optimierungen, die zu einem besseren Ressourcenmanagement führen, sind essenziell, um die Nachhaltigkeit der KI-Anwendungen zu gewährleisten.

Anwendungsgebiete von LLMs

Die praktischen Anwendungsgebiete von LLMs sind vielfältig und zeigen das Potenzial dieser Technologie, in unterschiedlichen Branchen bedeutende Veränderungen herbeizuführen. In der Kundenbetreuung werden LLMs zunehmend in Chatbots integriert, die in der Lage sind, auf Benutzeranfragen proaktiv zu reagieren. Diese Bots verwenden komplexe Dialogstrategien und können auch menschliche Emotionen und Stimmungen wahrnehmen, wodurch sie den Benutzern eine personalisierte Interaktion bieten. Solch ein Ansatz wird durch emotional artificial intelligence unterstützt, die zusätzlichen Kontext zu den Gesprächen liefert und somit die Interaktion menschlicher macht.

Im Gesundheitswesen finden LLMs ebenfalls Anwendung, indem sie Ärzte bei der Analyse von Diagnosedaten unterstützen und relevante Informationen aus medizinischen Fachartikeln oder Patientenberichten extrahieren. Diese Fähigkeit, große Informationsmengen zu handeln, bietet das Potenzial, Therapieempfehlungen zu optimieren und den Gesundheitsdienstleistungen entscheidend zu verbessern.

Außerdem haben LLMs das Potenzial, den Bereich des Lehrens und Lernens zu revolutionieren. Adaptive Lernplattformen können auf individuelle Lernstile und -geschwindigkeiten eingehen, sodass Lehrinhalte personalisiert und gezielt vermittelt werden. Dies stößt in der Diskussion um human-centered artificial intelligence auf Interesse, da es zeigt, wie KI-Technologien den Bildungsbereich menschlicher gestalten können.

Zukünftige Entwicklungen und Trends

Die Entwicklung von LLMs steht noch am Anfang, und viele Trends deuten darauf hin, dass sich diese Technologie in den nächsten Jahren dramatisch weiterentwickeln wird. Ein bedeutsamer Trend ist die Erhöhung der Multimodalität in Sprachmodellen. Zukünftige Modelle werden nicht nur Texte, sondern auch Bilder und andere Datentypen verarbeiten können, wodurch eine umfassendere und interaktive Benutzererfahrung geboten wird. Dies könnte neue Anwendungsgebiete eröffnen, beispielsweise in der kreativen Branche, wo LLMs in der Lage sein werden, Texte und visuelle Medien simultan zu erstellen.

Ein weiteres wichtiges Thema ist die Entwicklung von Kenntnissen für transferierbare Lernverfahren. Hierbei werden LLMs so optimiert, dass sie Wissen zwischen verschiedenen Aufgaben übertragen können. Beispielsweise könnte ein Modell, das für die Textgenerierung trainiert wurde, auch für Bildbeschreibungen oder die Verarbeitung von Audio-Signalen verwendet werden, was die Vielseitigkeit und Effizienz der Modelle erheblich steigern würde.

Zudem wird erwartet, dass mit dem Fortschritt der Technologie auch Standards für eine verantwortungsvolle Nutzung von LLMs und die Etablierung ethischer Richtlinien an Bedeutung gewinnen. Die Diskussion um Künstliche Intelligenz Ethik wird an Fahrt gewinnen, da zunehmend klar wird, dass die Apps, welche unsere Lebensweise beeinflussen, einer sorgfältigen Analyse und Regulierung bedürfen.

Fazit

Die Entwicklung von Large Language Models markiert einen bedeutenden Fortschritt auf dem Gebiet der künstlichen Intelligenz und zeigt, wie mächtig und anpassungsfähig diese Modelle sein können. Trotz ihrer beeindruckenden Fähigkeiten treten jedoch ernsthafte Herausforderungen und ethische Fragen auf, die nicht ignoriert werden dürfen. Künftige Entwicklungen in der Technologie und die Integration von Multimodalität sowie transferierbare Lernansätze könnten das Potenzial von LLMs weiter steigern. Um diese tiefgreifenden Veränderungen verantwortungsvoll zu gestalten, ist ein kontinuierlicher Dialog über die ethischen Rahmenbedingungen und die langfristigen Auswirkungen auf Gesellschaft und Umwelt unerlässlich. Der Weg in die Zukunft erfordert Innovation, aber auch ein starkes Engagement für die Kreation einer verantwortungsvollen KI-Landschaft.

❓ Häufig gestellte Fragen (FAQ)

Was sind Large Language Models?

Das sind tief lernende Modelle zur Texterzeugung und -verständnis.

Wie funktionieren LLMs?

Sie nutzen Selbstüberwachung und Transformer-Architektur zum Lernen.

Was sind die wichtigsten Algorithmen für das Training?

Adam-Optimierer, Layer Normalization und Transfer-Learning sind zentral.

Welche Herausforderungen gibt es bei LLMs?

Bias, Überanpassung und hohe Rechenressourcen sind wesentliche Probleme.

Wo werden LLMs angewendet?

In Chatbots, Gesundheitswesen und Bildungstechnologien.