💡 Key Takeaways auf einen Blick

- Transformer-Modelle revolutionieren die künstliche Intelligenz und Sprachverarbeitung.

- Self-Attention ermöglicht gleichzeitige Verarbeitung von Sprache und Bildern.

- Herausforderungen beinhalten Rechenaufwand, Erklärbarkeit und ethische Implikationen.

Transformer-Modelle haben in den letzten Jahren die Welt der künstlichen Intelligenz und des maschinellen Lernens revolutioniert. Ihre Fähigkeit, komplexe Sprach- und Bilddaten zu verarbeiten und zu verstehen, hat zu bemerkenswerten Fortschritten in vielen Anwendungen, insbesondere im Bereich der natürlichen Sprachverarbeitung (NLP), geführt. Die Architektur, die im Papier „Attention is All You Need“ von Vaswani et al. (2017) vorgestellt wurde, hat die Art und Weise, wie Modelle trainiert und angewendet werden, grundlegend verändert. Dieser Artikel wird die technischen Details und die Architektur von Transformer-Modellen im Detail beleuchten.

Grundlagen der Transformer-Modelle

Transformer-Modelle wurden entwickelt, um eine effizientere und flexiblere Verarbeitung von Sequenzdaten zu ermöglichen. Traditionelle Recurrent Neural Networks (RNNs) und Long Short-Term Memory (LSTM)-Netzwerke hatten Schwierigkeiten, lange Abhängigkeiten in Sequenzen zu erfassen, was oft zu Informationsverlust und einem langsamen Lernprozess führte. Die Transformer-Architektur adressiert diese Herausforderungen durch die Einführung des „Self-Attention“-Mechanismus, der es ermöglicht, alle Elemente einer Eingabesequenz gleichzeitig zu betrachten.

Self-Attention Mechanismus

Der Self-Attention-Mechanismus ist das Herzstück der Transformer-Architektur. Er berechnet, wie stark jedes Element einer Eingabesequenz mit allen anderen Elementen interagiert. Dies geschieht in drei Schritten:

-

Erzeugung der Abfrage-, Schlüssel- und Wert-Vektoren: Jedes Eingabeelement wird durch drei Vektoren transformiert: einen Abfrage-Vektor (Q), einen Schlüssel-Vektor (K) und einen Wert-Vektor (V). Diese Vektoren werden durch das Produkt der Eingabe mit den entsprechenden Gewichtungsmatrizen erzeugt.

-

Berechnung der Aufmerksamkeitsgewichte: Die Aufmerksamkeitsgewichte werden berechnet, indem das Skalarprodukt der Abfrage-Vektoren mit den Schlüssel-Vektoren durchgeführt wird. Dieses Ergebnis wird durch die Quadratwurzel der Dimension der Schlüsselvektoren geteilt, um die Stabilität der Gradienten zu gewährleisten und anschließend durch das Softmax-Verfahren normalisiert. Dadurch erhalten wir die Gewichte, die angeben, wie viel Aufmerksamkeit jedem Wert-Vektor geschenkt werden sollte.

-

Aggregation der Wert-Vektoren: Schließlich wird die gewichtete Summe der Wert-Vektoren gebildet, wobei die zuvor berechneten Aufmerksamkeitsgewichte verwendet werden. Das Ergebnis ist ein neuer Vektor, der die wichtigste Information der gesamten Eingabesequenz für ein gegebene Element zusammenfassen kann.

Vorteile der Transformer-Architektur

Die exklusiv auf „Attention“ basierende Architektur von Transformern hat mehrere Vorteile gegenüber traditionellen RNNs:

-

Parallele Verarbeitung: Während RNNs sequentiell arbeiten und daher in der Verarbeitung eingebremst werden, können Transformer-Modelle alle Elemente der Eingabesequenz parallel verarbeiten. Dies führt zu erheblichen Verbesserungen der Berechnungseffizienz und Beschleunigung des Trainingsprozesses.

-

Langfristige Abhängigkeiten: Der Selbst-Aufmerksamkeitsmechanismus ermöglicht es den Modellen, langfristige Abhängigkeiten in den Daten zu erfassen, ohne sich auf eine feste Fenstergröße oder auf sequenzielle Verarbeitung zu verlassen.

-

Flexibilität: Transformer-Modelle ermöglichen eine einfache Skalierung und Anpassung an verschiedene Aufgaben und Datensätze. Dank der Stabilität und Effektivität der Architektur können sie problemlos anwendungsspezifisch trainiert oder mit vortrainierten Modellen feinjustiert werden.

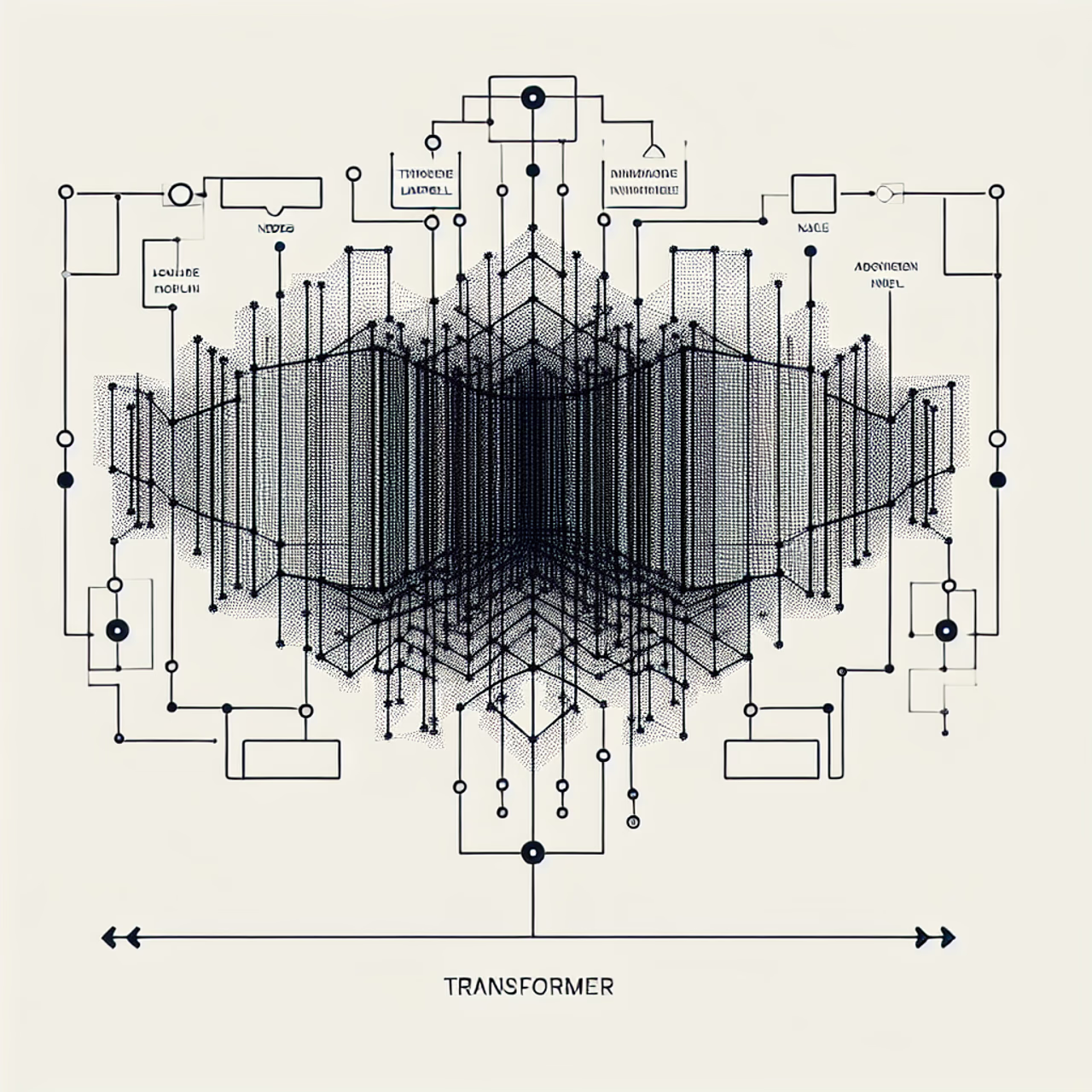

Die Architektur von Transformer-Modellen

Die Architektur der Transformer-Modelle besteht aus zwei Hauptkomponenten: dem Encoder und dem Decoder. Der Encoder verarbeitet die Eingabesequenz und der Decoder generiert die Ausgabesequenz. Diese Architektur ist besonders nützlich für Aufgaben wie maschinelles Übersetzen, wo eine Sequenz in eine andere umgewandelt werden muss.

Encoder

Der Encoder besteht aus mehreren identischen Schichten (häufig 6 oder mehr), wobei jede Schicht zwei Hauptteile umfasst: einen Self-Attention-Mechanismus und ein Feed-Forward-Netzwerk.

-

Self-Attention-Mechanismus: Jede Schicht des Encoders nutzt den Self-Attention-Mechanismus, um die Beziehungen zwischen den Eingabeelementen zu lernen. Dieser Mechanismus ermöglicht es dem Encoder, die relevanten Informationen aus der gesamten Sequenz zu aggregieren.

-

Feed-Forward-Netzwerk: Nach dem Self-Attention-Mechanismus erfolgt eine Transformation durch ein vollständig verbundenes Feed-Forward-Netzwerk, das nicht-linearisiert ist (typischerweise mit einem ReLU- oder GELU-Aktivierungsfunktion).

Zusätzlich dazu werden in jeder Schicht Residualverbindungen und Layer-Normalisierung verwendet, um den Trainingsprozess zu stabilisieren und die Leistung zu verbessern.

Decoder

Der Decoder funktioniert ähnlich wie der Encoder, hat jedoch eine zusätzliche Komponente: den Masked Self-Attention-Mechanismus. Diese Maskierung stellt sicher, dass während des Trainings bei der Vorhersage des nächsten Tokens nur auf die vorhergehenden Tokens zugegriffen werden kann, was bei der Generierung von Sequenzen erforderlich ist.

-

Masked Self-Attention: Diese Variante des Selbstaufmerksamkeitsmechanismus sorgt dafür, dass der Decoder nicht auf zukünftige Tokens zugreifen kann, was bei Aufgaben wie maschinellem Übersetzen notwendig ist, um sicherzustellen, dass die Vorhersagen für das nächste Wort nicht von zukünftigen Wörtern beeinträchtigt werden.

-

Feed-Forward-Netzwerk: Wie im Encoder besitzt auch der Decoder ein Feed-Forward-Netzwerk mit den gleichen Eigenschaften.

Die Decoder-Schichten enden mit einem linearen Layer und einer Softmax-Aktivierung, um die finalen Wahrscheinlichkeiten für die nächsten Tokens zu berechnen.

Insgesamt bieten die Transformer-Modelle eine leistungsstarke und flexible Lösung für die Verarbeitung von Sequenzdaten und haben sich schnell als Standard in vielen Bereichen der KI etabliert. Weitere Diskussionen über spezifische Anwendungsfälle und die Auswirkungen dieser Technologie werden im zweiten Teil dieser Artikelreihe behandelt.

Anwendung von Transformer-Modellen in der Praxis

Die vielfältigen Anwendungen von Transformer-Modellen erstrecken sich über verschiedene Industrien und Forschungsbereiche. Um die Kraft dieser Architektur voll auszuschöpfen, ist es von entscheidender Bedeutung zu verstehen, wie sie in spezifischen Szenarien implementiert wird und welche Herausforderungen dabei bewältigt werden müssen.

1. Natürliche Sprachverarbeitung (NLP)

Im Bereich der natürlichen Sprachverarbeitung haben Transformer-Modelle eine zentrale Rolle eingenommen. Modelle wie BERT und GPT haben das Verstehen von Sprache auf ein neues Niveau gehoben. Insbesondere BERT, das bidirectionale Kontextualisierung nutzt, ermöglicht es, semantische Beziehungen in Texten besser zu verstehen und bringt somit wesentliche Verbesserungen bei Aufgaben wie Fragenbeantwortung und Sentiment-Analyse.

Anders als bei traditionellen Ansätzen, die häufig auf Sequenz-zu-Sequenz-Methoden beschränkt sind, ermöglichen Transformers eine Kontextualisierung von Wörtern unter Berücksichtigung aller vorhergehenden und nachfolgenden Wörter in einem Satz. Bei der Implementierung stellen sich jedoch Fragen zur Datenauswahl und -vorverarbeitung, die kritisch für die Leistung des Modells sind.

2. Bildverarbeitung

Neben der Verarbeitung von Sprache finden Transformer-Modelle auch in der Bildverarbeitung Anwendung. Vision Transformers (ViTs) sind ein aufkommendes Konzept, das die Stärken der Transformer-Architektur auf Bilddaten anwendet. ViTs teilen Bilder in Patches auf und verwenden den Selbstaufmerksamkeitsmechanismus, um wichtige Merkmale zu identifizieren.

Der Einsatz von Transformer-Architekturen in der Bilderkennung hat das Potenzial, konventionelle CNNs in bestimmten Anwendungsfällen zu übertreffen. Dennoch bleiben Herausforderungen in Bezug auf die Trainingsdaten und die erforderliche Rechenleistung, die für das Training solcher Modelle notwendig ist, bestehend. Schließlich ist das Verständnis der inhärenten Biases, die in den Trainingsdaten liegen können, essentiell, um faire und effektive Modelle zu entwickeln.

3. Multimodale Anwendungen

Die Fähigkeit von Transformern, verschiedene Typen von Daten zu verarbeiten, eröffnet neue Möglichkeiten in den multimodalen Anwendungen, wo Text, Bild und andere Datenformen kombiniert werden. Diese Ansätze können in Bereichen wie der Robotik, der Gesundheitsversorgung und im autonomen Fahren verwendet werden, wo sie verschiedene Datenquellen nutzen müssen, um fundierte Entscheidungen zu treffen.

Ein Beispiel sind Systeme, die sowohl Bild- als auch Textinformationen verarbeiten, um Kontext zu verstehen und präzisere Antworten zu geben. Die Herausforderung besteht darin, wie diese unterschiedlichen Datenquellen integriert und interpretiert werden, um ein kohärentes und robustes Verständnis zu gewährleisten.

Herausforderungen und Zukunftsperspektiven von Transformer-Modellen

Trotz ihrer Erfolge sind Transformermodelle mit mehreren Schwierigkeiten konfrontiert, die es zu berücksichtigen gilt, wenn man über ihre Zukunft nachdenkt.

1. Rechenaufwand und Effizienz

Transformer-Modelle erfordern eine beträchtliche Menge an Rechenressourcen. Die Trainingszeiten sind lang, und die Energiekosten sind hoch, was in bestimmten Anwendungen wie der mobilen KI problematisch sein kann. Forscher arbeiten an Techniken zur Reduzierung der Modellkomplexität, wie etwa weniger Schichten, dramatisch verkleinerte Eingabegrößen oder gar hybride Modelle, die versuchen, die Vorteile beider Ansätze zu kombinieren.

2. Erklärbarkeit

Eine der größten Herausforderungen in der KI und im maschinellen Lernen ist die erklärbare KI. Während Transformer-Modelle hervorragende Genauigkeit erzielen können, bleibt es oft unklar, wie sie zu ihren Entscheidungen kommen. Dies stellt insbesondere im Gesundheitswesen, im Finanzsektor und in rechtlichen Kontexten ein Problem dar, wo die Transparenz und Erklärbarkeit entscheidend sind. Es gibt laufende Forschungen, die darauf abzielen, Techniken zu entwickeln, um die Entscheidungsfindung von Transformer-Modellen besser nachvollziehbar zu machen.

3. Ethische und gesellschaftliche Implikationen

Die Verwendung von Transformer-Modellen birgt auch Herausforderungen im Hinblick auf Ethik und Gesellschaft. Die Gefahr der Verstärkung von Vorurteilen, die bereits in den Trainingsdaten vorhanden sind, ist ein ernstzunehmendes Problem. Die Gesellschaft muss sicherstellen, dass diese Technologien verantwortungsbewusst eingesetzt werden und nicht zur Verstärkung von Diskriminierung oder Vorurteilen beitragen.

Fazit

Transformer-Modelle haben sich als revolutionär im Bereich der künstlichen Intelligenz erwiesen, insbesondere dank ihrer Flexibilität, Effizienz und Fähigkeit, komplexe Datenstrukturen zu verarbeiten. Ihre Vorteile sind klar, aber die Herausforderungen, die sie mit sich bringen, erfordern ein eigenes Maß an Aufmerksamkeit und Forschung. Mit dem fortschreitenden Verständnis und der Entwicklung in den angrenzenden Bereichen der erklärbaren KI, der Energieeffizienz und der ethischen Nutzung wird die Bedeutung von Transformern in der Zukunft nur noch zunehmen. Die nächste Generation von KIs dürfte eine noch stärkere Interaktion zwischen Mensch und Maschine ermöglichen, was neue Maßstäbe in der Technologie setzen wird. Die anhaltende Forschung und Entwicklung wird entscheidend dafür sein, diese Technik so zu gestalten, dass sie dem Gemeinwohl dient.

❓ Häufig gestellte Fragen (FAQ)

Was sind Transformer-Modelle?

Künstliche Intelligenz-Modelle, die Sequenzdaten effizient verarbeiten.

Wie funktioniert der Self-Attention-Mechanismus?

Er bewertet die Interaktion zwischen Eingabeelementen zur Informationsaggregation.

Welche Probleme stehen der Anwendung von Transformern gegenüber?

Hohe Rechenressourcen, mangelnde Erklärbarkeit und ethische Herausforderungen.