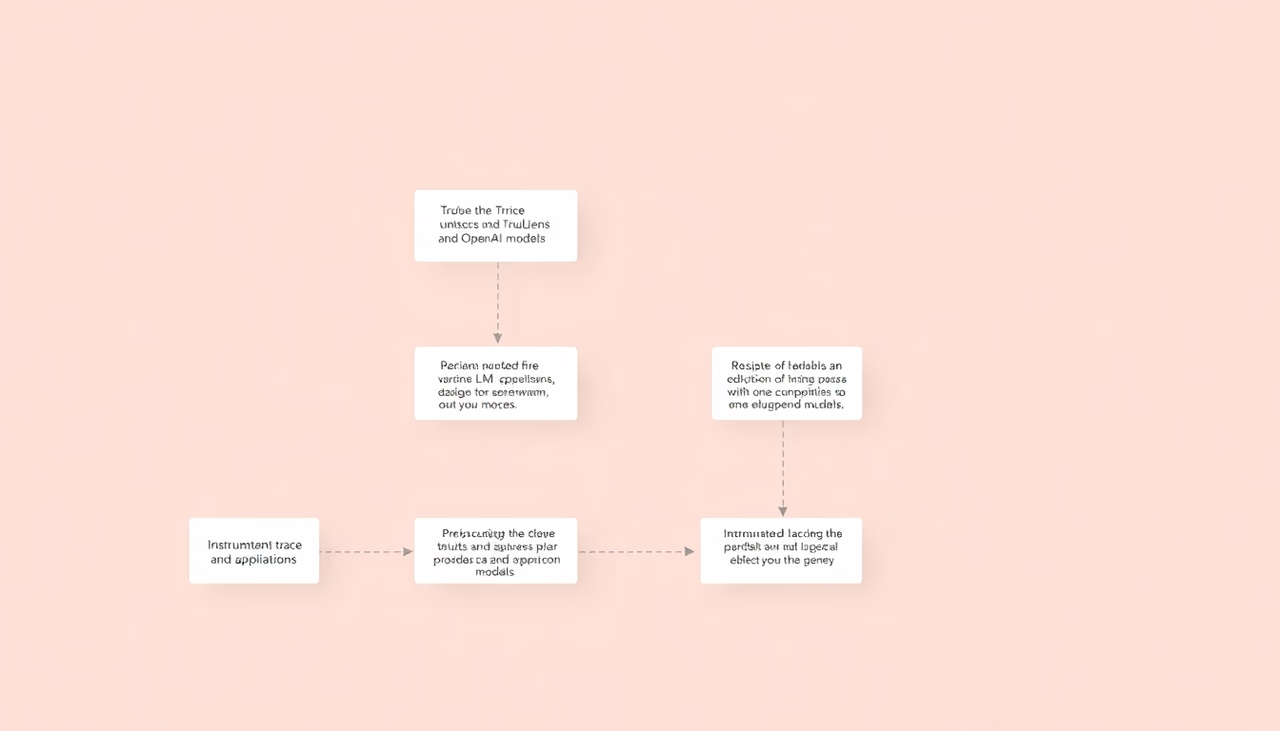

In der heutigen schnelllebigen Welt der künstlichen Intelligenz wird es immer wichtiger, die Leistung von Modellen, insbesondere von großen Sprachmodellen (LLMs), genau zu bewerten und verständlich zu gestalten. Die Herausforderung besteht darin, diese komplexen Systeme nicht als “Black Box” zu behandeln, sondern ihre Funktionsweise transparent zu machen. Die Verwendung von TruLens bietet eine robuste Lösung für die detaillierte Nachverfolgung und Bewertung von LLM-Anwendungen. In diesem Artikel werden wir einen tiefen Einblick in die Instrumentierung, Nachverfolgung und Bewertung solcher Anwendungen geben und versuchen die zentrale Terminologie und Mechanismen, die uns dabei helfen können, zu verstehen.

Was ist TruLens?

TruLens ist ein Framework, das entwickelt wurde, um die Nachverfolgbarkeit und Bewertung von LLM-Anwendungen zu erleichtern. Im Gegensatz zu herkömmlichen Ansätzen, bei denen oft nur die Endausgaben betrachtet werden, ermöglicht TruLens eine strukturierte Erfassung von Eingaben, Zwischenschritten und Ausgaben als nachvollziehbare „Spuren“. Dies eröffnet neue Möglichkeiten für die systematische Analyse und Verbesserung von Modellen.

Die Bedeutung der Instrumentierung

Eine der Hauptfunktionen von TruLens ist die Instrumentierung. Dies bedeutet, dass jeder Aufruf im Anwendungskontext erfasst wird, um Einsichten zu gewinnen, die zur Verbesserung der Leistungsfähigkeit führen können. Bei der Instrumentierung werden spezifische Punkte innerhalb einer Anwendung definiert, an denen Daten erfasst werden.

Wie funktioniert die Instrumentierung?

Die Instrumentierung erfolgt in mehreren Schritten. Zunächst müssen die Anwendungskomponenten identifiziert werden, die überwacht werden sollen, wie z.B. Datenabruf, Inferenz und Modell-Metriken. Durch das Hinzufügen von spezifischen Tracing-Punkten an diesen Stellen können wir alle relevanten Informationen sammeln. Diese Informationen werden dann verwendet, um Feedback zu gewähren und qualitative sowie quantitative Bewertungen vorzunehmen.

Beispiel für die Instrumentierung

Hier ist ein einfaches Beispiel für die Instrumentierung eines LLM-Anwendungssystems, das TruLens verwendet: python from trulens.core import TruSession, Feedback

session = TruSession() session.reset_database()

In diesem Code wird eine neue Sitzung erstellt und die Datenbank zurückgesetzt, um Platz für neue Aufzeichnungen zu schaffen. Für jede Benutzeranfrage können dann Rückmeldungen erfasst werden, die zur kontinuierlichen Verbesserung verwendet werden.

Nachverfolgung der LLM-Anwendungen

Die Nachverfolgung ist ein weiterer kritischer Aspekt, den TruLens stark unterstützt. Dabei wird nicht nur erfasst, was bei der jeweils letzten Anfrage passiert ist, sondern es wird auch nachvollziehbar dokumentiert, wie das Modell auf Änderungen der Eingabedaten reagiert. Dies schafft einen klaren Überblick über die Effizienz der verschiedenen Modellentwicklungen und der Parameter, die verwendet werden können.

Was müssen wir nachverfolgen?

- Eingaben: Alle Daten, die in das System eingegeben werden, sind relevant, um zu verstehen, wie das Modell auf unterschiedliche Anfragen reagiert.

- Ausgaben: Die Antworten des Modells müssen erfasst und kategorisiert werden.

- Zwischenschritte: Die Schritte zwischen Eingabe und Ausgabe sind oft entscheidend, um zu analysieren, wo Verbesserungen vorgenommen werden können. Dies bezieht sich insbesondere auf den Entscheidungsprozess des Modells.