💡 Key Takeaways auf einen Blick

- Frequentistische und bayesianische Ansätze repräsentieren zwei Hauptparadigmen in der Statistik.

- Frequentisten interpretieren Wahrscheinlichkeiten als relative Häufigkeiten in Experimenten.

- Bayesianer betrachten Wahrscheinlichkeiten als subjektiven Grad des Glaubens.

- Beide Ansätze bieten unterschiedliche Vorteile im Maschinenlernen.

- Interpretierbarkeit ist eine Herausforderung, insbesondere bei bayesianischen Modellen.

Frequentistischer und bayesianischer Ansatz sind zwei zentrale Paradigmen in der Statistik und Maschinenlernen, die unterschiedliche Philosophien zur Analyse und Interpretation von Daten und zur Modellbildung verfolgen. Im Kern differieren sie darin, wie sie mit Unsicherheit umgehen und wie sie Wahrscheinlichkeiten definieren und verwenden. Diese Unterschiede beeinflussen nicht nur die mathematischen Techniken, die bei der Modellierung eingesetzt werden, sondern auch die Interpretation der Ergebnisse, die mit den jeweiligen Ansätzen erzielt werden.

Ein wichtiger Aspekt ist, dass der frequentistische Ansatz eine langfristige Perspektive einnimmt, wobei Wahrscheinlichkeiten als relative Häufigkeiten in wiederholten Experimenten interpretiert werden. Dies steht im Gegensatz zum bayesianischen Ansatz, der Wahrscheinlichkeiten als subjektive Grade des Glaubens betrachtet, die auf bestehenden Kenntnissen und Informationen basieren. Diese Unterschiede sind nicht nur philosophischer Natur, sie haben auch praktische Auswirkungen auf das Maschinenlernen, wo Modelle darauf trainiert werden, Muster in Daten zu erkennen und Vorhersagen zu treffen.

Im Folgenden werden die Grundlagen der beiden Ansätze behandelt, um die technische Basis zu schaffen, bevor wir auf spezifische Anwendungen im Bereich des Maschinenlernens eingehen.

Grundlagen des frequentistischen Ansatzes

Definition und Konzepte

Der frequentistische Ansatz zur Statistik basiert auf dem Prinzip der Wiederholbarkeit. In diesem Rahmen wird die Wahrscheinlichkeit eines Ereignisses als der Grenzwert der relativen Häufigkeit dieses Ereignisses bei unendlich vielen Wiederholungen von Experimenten definiert. Zum Beispiel, wenn man einen Würfel unendlich oft wirft, würde die Wahrscheinlichkeit, eine Sechs zu werfen, als der Anteil der Sechsen unter den unendlichen Würfen interpretiert werden.

In der Praxis verwenden frequentistische Methoden oft Hypothesentests, Konfidenzintervalle und p-Werte. Hypothesentests sind Verfahren, mit denen entschieden wird, ob genügend Beweise vorliegen, um eine Nullhypothese abzulehnen. Ein p-Wert gibt an, wie wahrscheinlich es ist, ein Ergebnis zu beobachten, das ebenso extrem wie das beobachtete unter der Annahme der Nullhypothese ist. Diese grundlegenden Konzepte sind für die Analyse von Daten im Maschinenlernen entscheidend und ermöglichen es, Modelle zu evaluieren und ihre Leistung objektiv zu messen.

Beispiel für frequentistische Methoden im Maschinenlernen

Ein häufiges Beispiel für einen frequentistischen Ansatz im Maschinenlernen ist die lineare Regression, wo das Ziel darin besteht, die beste Gerade zu finden, die durch die Datenpunkte passt. Bei der Durchführung einer linearen Regression wird a priori die Nullhypothese aufgestellt, dass die Steigung der Regressionsgerade null ist. Durch die Berechnung von p-Werten kann dann entschieden werden, ob die Steigung signifikant von null abweicht. Hierbei werden auch Konfidenzintervalle für die Koeffizienten der Regression berechnet, um die Unsicherheit in den Schätzungen zu quantifizieren.

Ein weiteres Beispiel sind die Ansätze, die bei der Evaluierung von Modellen, wie der Kreuzvalidierung, verwendet werden. Hierbei wird der Datensatz in Trainings- und Testsets unterteilt, um die Leistung des Modells zu bewerten und Überanpassung zu verhindern. Diese Praktiken sind wichtig, um die generalisierenden Eigenschaften eines Modells zu beurteilen.

Grundlagen des bayesianischen Ansatzes

Definition und Konzepte

Im Gegensatz zum frequentistischen Ansatz verwendet der bayesianische Ansatz Wahrscheinlichkeiten als Maß für den Grad des Glaubens oder des Wissens über ein Ereignis. Dies bedeutet, dass die Wahrscheinlichkeiten nicht nur für die Daten selbst gelten, sondern auch für die Parameter, die ein Modell beschreiben. Ein zentrales Konzept bei der bayesianischen Statistik ist das Bayes-Theorem, das es ermöglicht, die Wahrscheinlichkeit von Hypothesen (Modellen) gegeben den Daten zu aktualisieren.

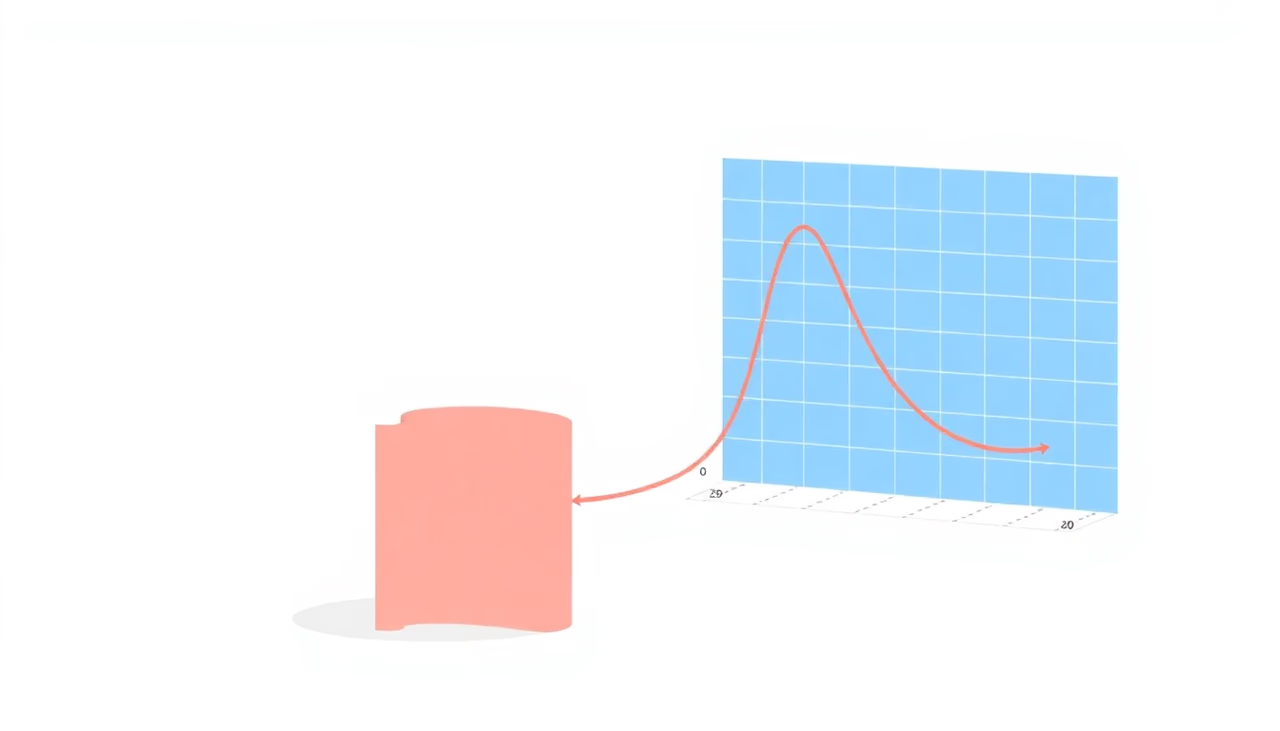

Bayes’ Theorem besagt, dass die posteriori Wahrscheinlichkeit einer Hypothese proportional zur prior Wahrscheinlichkeitsverteilung und der Likelihood der Daten ist. Diese Fähigkeit zur Aktualisierung von Überzeugungen basierend auf neuen Informationen ist eine Schlüsselstärke des bayesianischen Ansatzes und macht ihn besonders nützlich in dynamischen Umgebungen, in denen Daten kontinuierlich gesammelt werden.

Beispiel für bayesianische Methoden im Maschinenlernen

Ein typisches Beispiel für den bayesianischen Ansatz im Maschinenlernen ist die bayesianische lineare Regression, bei der die Unsicherheit über die Regressionsparameter in die Modellierung einfließt. Anstatt nur einen Punktestandard für die Schätzung der Steigung zu liefern, liefert die bayesianische Regression eine Verteilung der möglichen Werte, die die Unsicherheit um den geschätzten Wert darstellen. Diese Verteilung kann genutzt werden, um Vorhersagen mit Konfidenzintervallen zu treffen, die die Unsicherheit in den Schätzungen berücksichtigen.

Eines der Vorzüge der bayesianischen Methoden ist die Möglichkeit, Vorwissen über Parameter in Form von prior-Daten einzubringen. Dies kann in Umgebungen, in denen es schwierig ist, große Mengen an Daten zu sammeln, oder in denen bereits fundierte Ansichten über das Problem bestehen, besonders wertvoll sein. Die Anwendung bayesianischer Methoden ist in vielen Feldern populär, sei es in der medizinischen Diagnostik oder der Finanzanalyse, wo das Verständnis und die Quantifizierung von Unsicherheit von entscheidender Bedeutung sind.

Insgesamt bietet der bayesianische Ansatz einen flexiblen und adaptiven Rahmen zur Modellierung von Unsicherheiten, der in vielen modernen Ansätzen des Maschinenlernens Anwendung findet, einschließlich probabilistischer Graphnetzwerke und generativer Modelle.

Anwendungen im Maschinenlernen: Vergleiche der Ansätze

Eine der faszinierendsten Entwicklungen in der Anwendung der beiden Ansätze im Maschinenlernen ist die Analyse, wie sie sich auf verschiedene Technologien auswirken. Der frequentistische Ansatz, der sich auf die Leistung und Evaluierung von Modellen durch Hypothesentests stützt, und der bayesianische Ansatz, der sich in dynamischen Umgebungen hervorragend anpassen lässt, bieten jeweils distinctiven Vorteile, die je nach Anwendungsfall entscheidend sein können.

Ein zentrales Beispiel für den Einsatz beider Ansätze ist das Bereich des Reinforcement Learning, besonders im Hinblick auf die Fortschritte, die durch sicherheitskritisches Reinforcement Learning erzielt werden. Hierbei ist die strenge mathematische Handhabung von Wahrscheinlichkeiten im frequentistischen Rahmen äußerst wichtig, da sie die Robustheit des Modells gewährleistet. Die Bayes’sche Inferenz kann jedoch auch zur Verbesserung der Entscheidungsfindung in dynamischen und unsicheren Zuständen genutzt werden, wo kontinuierliche Lernprozesse erforderlich sind.

Ein weiteres bemerkenswertes Beispiel für die Arbeit mit bayesianischen Methoden in modernen Anwendungen ist die Verfeinerung von generativen Modellen, die zur Schaffung von Inhalten verwendet werden. Dies umfasst Techniken, die auf dem Konzept der generativen KI basieren, wobei die Anpassungsfähigkeit der bayesianischen Ansätze entscheidend ist, um die Qualität und Aussagekraft der generierten Inhalte zu verbessern. Insbesondere in kreativen Bereichen, wie der Video- und Bildgenerierung oder beim Entwurf von Texten durch Modelle, ist die Implementierung von Unsicherheitsanalysen durch Bayes’sche Ansätze sowohl für die Kreativität als auch für die Konsistenz wichtig.

Schließlich zeigt sich auch in der Entwicklung robuster Textgenerierungsmodelle, etwa durch große Sprachmodelle, wie bedeutend die Wahl zwischen einem frequentistischen und einem bayesianischen Ansatz für die Ergebnisse der Modellierung sein kann. Während die frequentistischen Methoden stark auf Datensätze fokussiert sind, um zu lernen und Vorhersagen zu treffen, bieten bayesianische Ansätze die Möglichkeit, Vorwissen effizient zu integrieren, was zu besonders genauen Ergebnissen führen kann. Dies ist insbesondere bei der Verarbeitung und Analyse von großen Datenmengen von Bedeutung, wo der Kontext eine entscheidende Rolle spielt.

Herausforderungen und Einschränkungen

Trotz der überzeugenden Eigenschaften beider Ansätze gibt es auch Herausforderungen und Einschränkungen, die konzeptionell und praktisch relevant sind. Ein relevanter Faktor ist die Interpretierbarkeit der Modelle. Während frequentistische Methoden eher standardisiert sind und klare Metriken (wie p-Werte) liefern, ist die Interpretation bayesianischer Modelle oft wesentlich komplexer. Der Bedarf an soliden probabilistischen Überlegungen und mathematischen Fähigkeiten kann potenziell zu Missverständnissen führen, insbesondere wenn die Benutzerbasis aus Personen besteht, die nicht auf statistische Bildung spezialisiert sind.

Außerdem kann die Wahl des prior im bayesianischen Verfahren ausgesprochen problematisch sein. Eine ungenaue oder voreingenommene Wahl kann die Ergebnisse erheblich verzerren. Diese Herausforderung wird umso signifikanter, wenn das Wissen über das beobachtete Phänomen begrenzt ist. Im Vergleich dazu gibt es im frequentistischen Ansatz ein höheres Maß an objektiven Standards und klaren Tests, die vor, während und nach der Analyse von Daten angewendet werden können.

Das Balancieren dieser Aspekte wird zunehmend wichtig, insbesondere da KI-Technologien wie beispielsweise in der Emotionale Intelligenz in Künstlicher Intelligenz fortschreiten. In solchen sensiblen Anwendungsgebieten sind unbedachte Entscheidungen in der Wahl der Methodologie nicht nur eine theoretische Herausforderung, sondern haben praktische Auswirkungen auf Wahrhaftigkeit, Transparenz und die allgemeine Akzeptanz der Ergebnisse.

Fazit: Ein integrativer Weg in die Zukunft

Insgesamt zeigt die Untersuchung der frequentistischen und bayesianischen Ansätze, dass es keinen universellen „richtigen“ Weg gibt, um mit Unsicherheit in Daten umzugehen. Vielmehr werden beide Ansätze immer relevantes Wissen zu offerieren, das unter Berücksichtigung sich wandelnder Anforderungen in verschiedenen Feldern unterschiedlich gewichtet werden muss. Maschinenlernen wird durch die Kombination der Stärken beider Paradigmen weiter florieren können, wobei die Notwendigkeit der Interpretierbarkeit und der Robustheit von Modellen nicht vergessen werden darf.

Die Zukunft wird durch die Integration beider Ansätze geprägt sein. Dies wird durch die Notwendigkeit unterstützt, sich an dynamisch ändernde Umgebungen anzupassen und mit neuen Technologien Schritt zu halten. Die Verknüpfung von robusten frequentistischen Methoden mit der Flexibilität bayesianischer Ansätze könnte der Schlüssel zu den Lösungen sein, die für die Herausforderungen der Zukunft im Bereich von Künstlicher Intelligenz und Maschinenlernen notwendig sein werden.

❓ Häufig gestellte Fragen (FAQ)

Was ist der Unterschied zwischen frequentistischen und bayesianischen Ansätzen?

Der Unterschied liegt in der Interpretation und dem Umgang mit Wahrscheinlichkeiten und Unsicherheiten.

Wann sollte ich den bayesianischen Ansatz verwenden?

Wenn Vorwissen einfließen soll oder in dynamischen Umgebungen, wo Daten kontinuierlich gesammelt werden.

Wie funktionieren p-Werte im frequentistischen Ansatz?

P-Werte quantifizieren die Wahrscheinlichkeit, ein beobachtetes Ergebnis unter der Nullhypothese zu erhalten.

Was sind die Herausforderungen beim bayesianischen Ansatz?

Die Wahl des priors und die komplexe Interpretation der Modelle können problematisch sein.